Zeitpunkt Nutzer Delta Tröts TNR Titel Version maxTL Mo 22.07.2024 00:01:26 28.490 -2 2.079.452 73,0 Mastodon 4.2.10 500 So 21.07.2024 00:04:51 28.492 0 2.078.716 73,0 Mastodon 4.2.10 500 Sa 20.07.2024 00:05:01 28.492 -1 2.078.031 72,9 Mastodon 4.2.10 500 Fr 19.07.2024 14:03:47 28.493 0 2.077.495 72,9 Mastodon 4.2.10 500 Do 18.07.2024 00:03:24 28.493 0 2.076.400 72,9 Mastodon 4.2.10 500 Mi 17.07.2024 00:03:49 28.493 0 2.075.834 72,9 Mastodon 4.2.10 500 Di 16.07.2024 00:03:55 28.493 0 2.074.904 72,8 Mastodon 4.2.10 500 Mo 15.07.2024 00:03:51 28.493 0 2.074.189 72,8 Mastodon 4.2.10 500 So 14.07.2024 00:03:45 28.493 0 2.073.237 72,8 Mastodon 4.2.10 500 Sa 13.07.2024 00:04:43 28.493 0 2.072.565 72,7 Mastodon 4.2.10 500

Eric Florenzano (@ericflo) · 04/2017 · Tröts: 1.730 · Folger: 342

Mo 22.07.2024 19:11

Holy moly

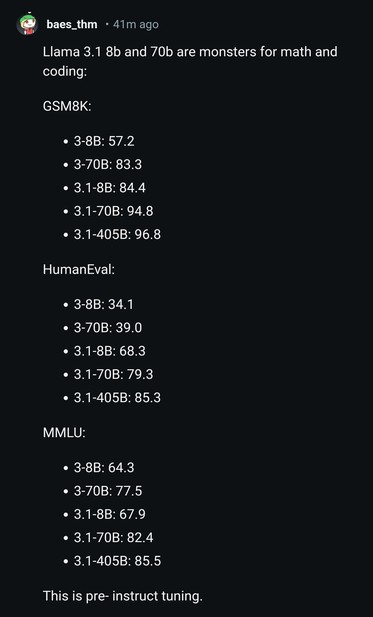

Llama 3.1 8b and 70b are monsters for math and coding: GSM8K: 3-8B: 57.2 3-70B: 83.3 3.1-8B: 84.4 3.1-70B: 94.8 3.1-405B: 96.8 HumanEval: 3-8B: 34.1 3-70B: 39.0 3.1-8B: 68.3 3.1-70B: 79.3 3.1-405B: 85.3 MMLU: 3-8B: 64.3 3-70B: 77.5 3.1-8B: 67.9 3.1-70B: 82.4 3.1-405B: 85.5 This is pre- instruct tuning.

[Öffentlich] Antw.: 0 Wtrl.: 0 Fav.: 0 · via Elk